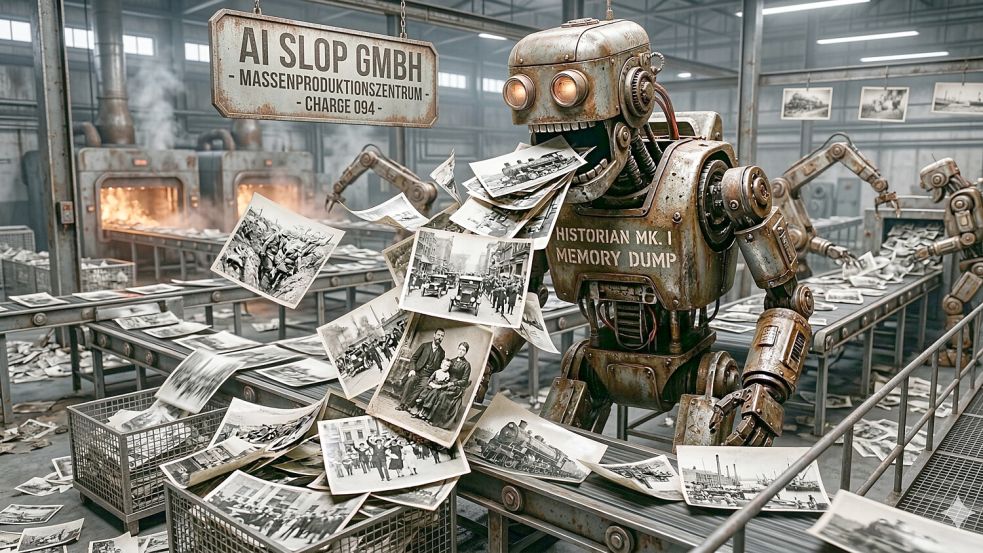

Osnabrück Wie KI-Schrott das Internet flutet – und sich an der Geschichte vergeht

Massenhaft produzierte KI-Inhalte verstopfen Soziale Netzwerke und nerven Nutzer. Auch vor der Geschichte machen die oft miserablen Machwerke nicht Halt. Was bedeutet das für Historiker?

Es klingt nach einer entspannenden Grusel-Unterhaltung für einen verregneten Sonntagnachmittag auf dem Sofa. 1896, heißt es im Teaser eines Youtube-Videos, habe eine im Harz ansässige Bauernfamilie, die „makabre Familie Krüger“, in ihrem Haus reihenweise Menschen ermordet. Das entsprechende Haus ist im Vorschaubild zu sehen, dazu düster gekleidete und dreinblickende Frauen und etwas, das nach Grabsteinen aussieht. Dauer des Films: fast 47 Minuten. Fast wie eine richtige Doku.

In anderen, ähnlich betitelten Videos heißt die Familie nicht Krüger, sondern Keller oder Fischer; sie ist aber fast immer „makaber“. Mal spielen die Moritaten schon im Jahr 1850, mal 1910; mal liegt der Tatort anderswo im Harz, mal im Bayerischen Wald, mal in Thüringen. Die Youtube-Kanäle, auf denen sie erscheinen, heißen „Schreckliches Nachtgeflüster“, „Verbotene Akten“ oder „Erschreckende Geschichten“.

Statt für prickelnde Gänsehaut sorgt ein Klick auf eines dieser Videos allerdings schnell für Ernüchterung. Über die gesamte Dauer des Films ist in der Regel bloß ein Standbild zu sehen; eine sonore Stimme leiert die erfundene Mord-Story dazu herunter. Länger als ein paar Minuten hält das kaum jemand aus, aber das dürfte den Machern des Videos egal sein: Der Klick ist ja bereits gemacht, die Einnahmen können fließen.

Willkommen in der Welt der „AI-Slops“.

Mit diesem Begriff werden massenhaft mit KI erzeugte Billiginhalte bezeichnet, die derzeit nicht nur Youtube, sondern auch andere Soziale Netzwerke regelrecht fluten. Schätzungen gehen davon aus, dass mehr als 40 Prozent aller längeren Facebook-Posts mittlerweile KI-generiert sind, außerdem die Hälfte aller englischsprachigen Posts auf Linkedin, ebenso jedes vierte Tiktok-Video. Belastbare Statistiken gibt es dazu zwar nicht, klar ist aber: Es sind sehr, sehr viele maschinell erstellte Ramsch-Inhalte, die den Nutzern tagtäglich zum Fraß vorgeworfen werden. So viele, dass „Slop” – das im Englischen unter anderem „Fraß“ bedeutet – in den USA zum Wort des Jahres erklärt wurde. Mehr Beispiele gefällig?

Zwei Kinder mit einer Torte auf einer Schnellstraße sitzend, eines von ihnen ist verstümmelt; sie bitten um Geburtstags-Likes. Beide Kinder haben Vollbärte.

Hollywoodstar Keanu Reeves in einem Krankenhausbett, ein Pappschild haltend, auf dem steht, dass dies sein letzter Post sein könnte – er habe Krebs im Endstadium.

Ein Kurzvideo von einem angeblich vergessenen unterirdischen Panzerfriedhof aus dem Kalten Krieg. Aus den Panzertürmen ragen sowohl vorne als auch hinten Kanonenrohre.

Viele dieser Inhalte sind leicht als Fake zu erkennen, einige sind offen unappetitlich, andere wirken zunächst vergleichsweise harmlos. Der Youtube-Kanal „Sleepless Historian“ etwa wirbt mit historischen Gutenachtgeschichten und bringt nahezu jeden Tag ein neues Video heraus, in dem zwei Stunden lang über irgendein geschichtliches Thema schwadroniert wird, monoton vorgetragen und lieblos illustriert durch Künstliche Intelligenz.

Wie lieblos, zeigt sich etwa bei einem Video zum Alten Rom: Nach einem Drittel der Laufzeit verschwindet das Bild einfach, der Nutzer sieht danach eineinhalb Stunden lang einen schwarzen Screen. Aber erstaunlicherweise bemängelt kein einziger der rund 60 Kommentatoren diese Panne – stattdessen wird die inhaltliche Güte bejubelt oder schlicht die Uhrzeit genannt, zu der das Video angeblich geschaut wurde, wegen „Sleepless”. Viele der Kommentatoren sind erst seit Kurzem registriert, kaum einer hat selbst Inhalte hochgeladen – es ist sehr wahrscheinlich, dass es sich hauptsächlich um Bots handelt.

KI, die KI-Inhalte kommentiert, woraufhin – wegen des großen Erfolgs – mehr KI-Inhalte erzeugt werden: Es ist, als würde sich die zehn Jahre alte und nur halb spaßig gemeinte Theorie des „toten Internets“, in dem ein Großteil der Interaktionen nicht mehr von Menschen, sondern von Bots geleistet werde, doch noch bewahrheiten.

Bislang haben viele Nutzer den KI-Müll vor allem als lästig empfunden. Zuletzt aber schlugen mehrere Gedenkstätten laut Alarm: Im Umfeld des Holocaust-Gedenktags am 27. Januar tauchten Unmengen an KI-generierten Bildern auf, die emotional aufgeladene, aber vollkommen erfundene Szenen aus KZs zeigten. Das Ziel der Content-Ersteller: mit Gefühlen Kasse machen. Denn für die Höhe der Werbeeinnahmen zählen neben den Klicks auch Reaktionen anderer Nutzer – und die lassen sich mit herzzerreißenden Szenen leichter hervorlocken.

„KI-generierte Inhalte verfälschen die Geschichte durch Verharmlosung und Verkitschung“, warnten die Gedenkstättenvertreter. Durch Veränderung der Sehgewohnheiten, würden Nutzer „zunehmend auch authentische historische Dokumente anzweifeln“. Und, schlimmer noch: Die Inhalte würden „gezielt eingesetzt, um historische Fakten zu verwässern, Opfer- und Täterrollen zu verschieben oder revisionistische Narrative zu verbreiten“.

Beispielsweise in einem atemberaubend fehlerstrotzenden KI-Ranking, das der X-Kanal „Insane AI Slop“ als besonders schlechtes Beispiel ausgegraben hat. Auf dem Bildchen, das seine Runde auf Facebook machte und die „brutalsten Führer der Geschichte“ zeigen wollte, wird Adolf Hitler erst hinter dem belgischen König Leopold, dem ugandischen Diktator Idi Amin und dem kambodschanischen Despoten Pol Pot verortet. Der Subtext dieses schwer verdaulichen Social-Media-Häppchens: Andere waren offensichtlich noch weit schlimmer als das NS-Regime.

Hat die Fachwelt überhaupt noch eine Chance, gegen diese Flut an KI-Geschichtsschrott anzukommen? „Wenn versucht wird, einen KI-generierten Inhalt wie eine authentische Quelle aussehen zu lassen und ihn als solche durch die Sozialen Medien zu treiben“, dann sei das ein Problem, sagt Sebastian Kubon, Historiker an der Münchner Uni. Allerdings lasse sich auch mit echten Bildern manipulieren, indem man sie aus dem Kontext reiße; und ganz neu sei das Phänomen an sich nicht: „Seit es Fotos gibt, werden sie auch verfälscht.“ Letztlich sei Quellenkritik „die Kernaufgabe des Historikers – ob es nun um die Frage geht, ob eine mittelalterliche Urkunde gefälscht ist oder eben ein Foto“.

Da aber KI-generierte Inhalte künftig immer schwieriger als solche erkennbar sein werden, müsse beim Nutzer angesetzt werden: „Menschen, denen so etwas in ihrer Timeline vorgesetzt wird, müssen befähigt werden zu erkennen, was genau sie da eigentlich sehen“, sagt Kubon. „Warum finde ich dieses Bild auf dieser Internetseite? Was soll der Kontext sein, ist der plausibel? Welche Geschichten werden da erzählt?“ Die Aufgaben des Historikers, sagt er, werden sich dadurch künftig eher noch ausweiten.

Die Gedenkstätten hatten die Plattformbetreiber in ihrem offenen Brief aufgerufen, aktiv gegen solche Inhalte vorzugehen. Dass das passieren wird, ist fraglich. Zwar hatte etwa Youtube schon im vergangenen Sommer angekündigt, härter gegen die Massenware aus dem KI-Bastelzimmer vorgehen zu wollen, ein wirklicher Effekt ist aber nicht feststellbar. Und der Meta-Konzern ermuntert seine – immerhin noch drei Milliarden – Facebook-Nutzer sogar, mit den eingebauten KI-Tools Inhalte zu generieren. Und damit Traffic, mit dem die Plattform wiederum Werbekunden lockt.

Weggehen werde dieses Phänomen nicht mehr, sagt auch Historiker Kubon: „Aber das Abendland wird dadurch auch nicht untergehen, glaube ich.“ Es biete auch Möglichkeiten. Und, „so wie Marcel Reich-Ranicki mal über das Fernsehen gesagt hat: Die Klugen macht es klüger und die Dummen macht es dümmer. Man muss die Potenziale eben richtig nutzen.“