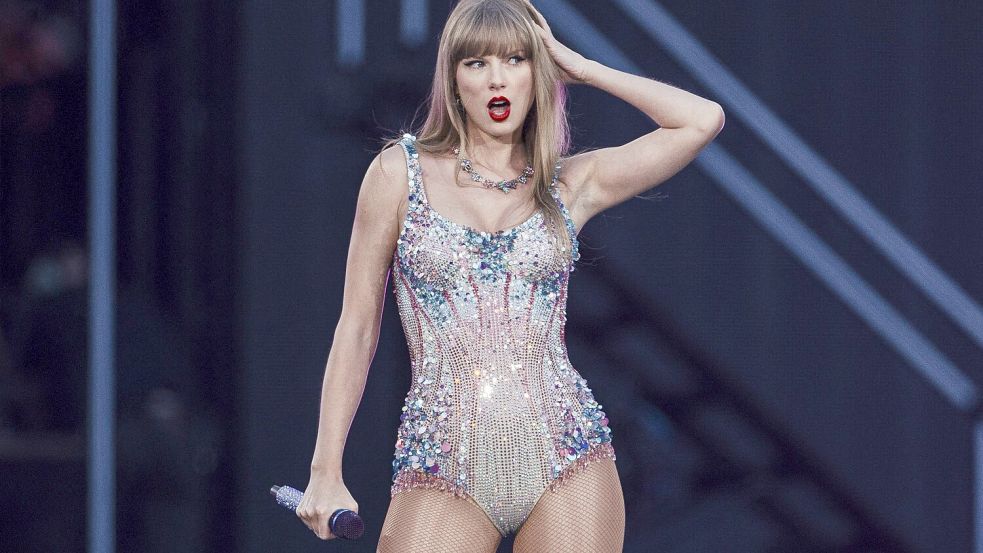

Hamburg KI von Elon Musk: Grok erstellt ungefragt Nacktvideos von Promis wie Taylor Swift

Elon Musks künstliche Intelligenz Grok erstellt mit einer neuen Einstellung ungefragt erotische Bilder und Videos von Prominenten wie Taylor Swift – ohne deren Wissen oder Einverständnis.

Mit dem KI-Tool Grok will Elon Musk ChatGPT, Gemini und Co. Konkurrenz machen. Insbesondere beim Erstellen von KI-generierten Bildern und Videos soll der Chatbot von Musks Unternehmen xAI neue Maßstäbe setzen.

Das zumindest hat Grok auf eine Weise geschafft, die für Betroffene sehr unerfreulich ist: Das neuste Modell erstellt erotische Fotos oder Videos von Prominenten – und das teilweise ohne expliziten Auftrag oder deren Erlaubnis.

Einer Journalistin des US-Magazins „The Verge“ lieferte Grok bei einem Test Inhalte, die Taylor Swift in knappen Outfits, erotischen Posen oder gleich Oben ohne zeigen. Schuld daran ist eine Voreinstellung der neuesten Grok-Version mit dem Namen „Spicy“. Wörtlich übersetzt heißt das „würzig“, im Kontext könnte es auch mit „schlüpfrig“ übersetzt werden.

Wird die Einstellung genutzt, neigt Grok dazu, Bilder und Videos mit anzüglichen Inhalten zu „würzen“. Im Test habe die Journalistin die KI dazu aufgefordert, basierend auf einem Bild von Taylor Swift ein Video zu erstellen, in dem die Sängerin auf einem Musik-Festival mit einigen männlichen Personen feiert.

Als Ergebnis spuckte Grok demnach einen Clip aus, der eine KI-generierte Swift im knappen Outfit und tanzend zeigt, die sich unvermittelt ihr Oberteil vom Leib reißt – ohne, dass die KI bei Erstellung des Videos dazu aufgefordert wurde.

Die Inhalte sind laut „The Verge“ zwar „nicht perfekt“, auf den ersten Blick aber durchaus realistisch. Dass die abgebildete Person Taylor Swift zeigen soll, ist dagegen eindeutig. Grok habe für die „Spicy“ Version zwar einen Alterstest verlangt, der aber ohne Nachweis umgangen werden könne.

Ob es sich bei den expliziten Inhalten von Grok um eine neue und gewollte Funktion oder einen Fehler handelt, ist unklar. Laut „The Verge“ erstellt die KI bei direkter Aufforderung keine Nacktvideos oder -bilder von Prominenten. Nur über den Umweg mit der „Spicy“-Voreinstellung sei dies möglich. Die Statuten von Grok selbst verbieten eigentlich das „Darstellen von realen Personen in pornografischer Weise“.

Taylor Swift dürfte über die Inhalte von Grok alles andere als erfreut sein. Bereits 2024 wurden ohne Erlaubnis erstellte Nacktbilder von ihr auf Musks Social-Media-Plattform X geteilt. Ob sie gegen die neuen Fake-Videos klagen wird, ist nicht bekannt. Aussichtsreich dürfte das für die Sängerin laut „The Verge“ allerdings sein. Der ‚Spicy‘-Modus von Groks neuer generativen KI sei eine Steilvorlage für eine Klage gegen xAI, heißt es dort. Die Fake-Nacktdarstellungen von Swift wird das jedoch nicht rückgängig machen.