Kolumne „Digital total“ Auch die KI ist nicht frei von Vorurteilen

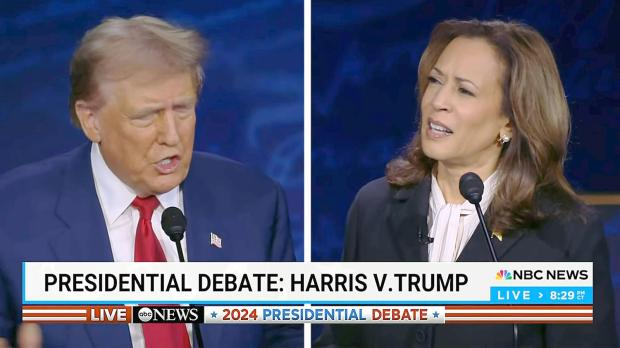

Künstliche Intelligenz sah Kamala Harris als Siegerin der US-Präsidentschaftswahl. Doch es gewann Donald Trump. Warum lagen die Algorithmen daneben? Dieser Frage geht unser Kolumnist heute nach.

Im Vorfeld der US-Präsidentschaftswahl gab es mehrere Versuche, das Ergebnis der Wahl mit Hilfe von KI-Algorithmen vorauszusagen. Dabei haben mich die Voraussagen der Künstlichen Intelligenz ziemlich erstaunt, denn die Algorithmen haben fast ohne Ausnahme Kamala Harris als wahrscheinlichste Siegerin vorausgesehen.

Ich fand das ziemlich merkwürdig, da ich mir schon im November 2023 so sicher war, dass Trump gewinnt, dass ich diese Vorhersage furchtlos in einem Artikel getroffen habe. Und die Anschläge auf Trump sowie der Tausch von Biden gegen Harris hatten meiner Ansicht nach die Chancen von Trump nur weiter erhöht.

Da stellt sich doch die Frage, warum die KI in fast allen Fällen daneben lag. Meiner Meinung nach ist dieser Fall ein gutes Beispiel dafür, dass auch der beste statistische Algorithmus rein gar nichts taugt, wenn er mit schlechten Daten geführt wird. Der Spruch „Du bist, was du isst“ gilt anscheinend auch für die KI. Dementsprechend impfen Programmierer ihre Vorurteile fast automatisch auch in ihre Software ein.

Zur Person

Fabian Scherschel, geboren in Duisburg und nun in Düsseldorf lebend, arbeitete bis 2019 als Redakteur für das Tech-Portal Heise-Online und für die Tech-Newsseite „The H“ in London. Als Freiberufler schreibt er unter anderem für das Magazin „c’t“. Mittlerweile hat der begeisterte Podcaster sein eigenes Projekt: fab.industries. Fernseh- und Radiosender schätzen ihn als Experten.

Bei KI-Algorithmen geschieht dies meist über die Auswahl der Quellen, aus der die KI ihre Rohdaten bezieht. Und da die Mitarbeiter von Silicon-Valley-Firmen zum Großteil die Demokraten wählen, ist es naheliegend, dass ihre KIs deren Kandidatin als wahrscheinlichsten Gewinner gesehen haben.

Das ist genau der Grund, warum man die Vorhersagen von KIs – und von Computer-Modellen im Allgemeinen – immer mit Vorsicht genießen sollte. Denn solche Modelle entstehen nie in einem Vakuum. Sie spiegeln immer auch die Werte, Vorurteile und Ansichten ihrer Schöpfer wieder und sind deswegen eben kein Ausdruck reiner Wissenschaft oder objektiver Mathematik. Menschen haben bisher noch nichts erschaffen, in dem der Faktor Mensch keine Rolle gespielt hat. Dessen sollten wir uns bewusst sein, wenn uns das nächste Mal jemand eine KI als der Weisheit letzter Schluss präsentieren will.

Kontakt: kolumne@zgo.de